移动网络

无线网络性能,第七章

截至 2024 年初,全球蜂窝连接数已超过85 亿,其中 5G 连接数超过20 亿。IDC 市场情报报告显示,仅 2023 年一年,智能连接设备(智能手机、平板、笔记本、PC 等)的出货量就达到约12 亿台。更令人瞩目的是未来的增长曲线:IDC 预测到 2027 年,新设备年出货量将攀升至15 亿台以上,而其他累积预测估计到 2030 年全球连接设备总数将超过500 亿台。

2024 年全球人口约81 亿,预计到 2030 年将增至85 亿。这些趋势揭示了一个不争的事实:我们对智能连接设备的渴求似乎永无止境——显然,大多数人并不满足于仅拥有一台设备。

然而,连接设备的绝对数量只是冰山一角。隐含在这一增长背后的,是对高速连接、无处不在的无线宽带接入以及支撑这些新设备的服务的无尽需求。这正是我们必须深入探讨各种蜂窝技术(如 GSM、CDMA、HSPA、LTE 和 5G)性能表现的原因。很可能,您的绝大多数用户正依赖其中一种技术(有些甚至完全依赖)来访问您的网站或服务。赌注很高,我们必须做对,而移动网络确实带来了一系列独特的性能挑战。

G 的简史

要在纷繁复杂的蜂窝标准、版本发布以及各自的优缺点中理清头绪,恐怕不是几章篇幅能够涵盖的,而是需要整本书的体量。我们的目标要谦逊得多:我们需要建立对主要里程碑(表 7-1)的运行参数及其影响的直觉,这些里程碑代表了市场中占主导地位的无线技术的过去与未来。

| 代际 | 峰值数据速率 | 描述 |

|---|---|---|

| 1G | 无数据 | 模拟系统 |

| 2G | Kbit/s | 首个数字系统,作为模拟系统的叠加或并行网络 |

| 3G | Mbit/s | 与模拟系统并行部署的专用数字网络 |

| 4G | Gbit/s | 全数字、全分组网络 |

| 5G | 10+ Gbit/s | 增强型移动宽带、超可靠低延迟通信、大规模物联网 |

表 7-1. 移动网络代际

首先需要认识到的是,每一代无线标准的底层规范都以**峰值频谱效率(bps/Hz)**来表达,这随后被转化为令人印象深刻的数字,例如 4G 网络的 Gbit/s+峰值数据速率,或 5G 的 10+ Gbit/s。然而,您应该注意到前一句话中的关键词:峰值!回想我们之前关于测量真实无线性能的讨论——峰值数据速率是在理想条件下实现的。

无论标准如何,每个网络的真实性能都会因运营商、网络配置、特定小区内的活跃用户数量、特定位置的无线电环境、使用的设备以及所有其他影响无线性能的因素而有所不同。鉴于此,虽然真实环境中的数据速率无法保证,但一个简单却有效的策略是:对每一代网络,假设吞吐量更接近下限,而数据包延迟更接近上限(表 7-2)。

| 代际 | 数据速率 | 延迟 |

|---|---|---|

| 2G | 100–400 Kbit/s | 300–1000 ms |

| 3G | 0.5–5 Mbit/s | 100–500 ms |

| 4G | 1–50 Mbit/s | < 100 ms |

| 5G | 10–1000 Mbit/s | < 10 ms |

表 7-2. 活跃移动连接的数据速率与延迟

更让情况复杂的是,将任何给定网络简单归类为 3G、4G 或 5G 显然过于粗糙,相应的吞吐量和延迟预期也是如此。要理解为何如此以及行业正走向何方,我们首先需要快速回顾不同技术的历史及其关键推动者的演进历程。

2G 时代的首批数据服务

首个商用 1G 网络于 1979 年在日本推出。这是一个模拟系统,不提供数据能力。1991 年,首个 2G 网络在芬兰基于新兴的GSM(全球移动通信系统,原称 Groupe Spécial Mobile)标准推出,在无线网络中引入了数字信令。这使得首批电路交换移动数据服务成为可能,如短信(SMS),以及高达9.6 Kbit/s峰值数据速率的数据包传输!

直到 1990 年代中期,通用分组无线服务(GPRS)首次被引入 GSM 标准,无线互联网接入才成为一种实际可能,尽管速度仍然很慢:通过 GPRS,您现在可以达到172 Kbit/s,典型往返延迟在数百毫秒的高位徘徊。GPRS 与早期 2G 语音技术的结合通常被称为2.5G。几年后,这些网络通过EDGE(GSM 演进增强数据速率)得到增强,峰值数据速率提升至384 Kbit/s。首批 EDGE 网络(2.75G)于 2003 年在美国推出。

此时,值得暂停片刻进行反思。无线通信已有数十年历史,但移动网络上的实用、面向消费者的数据服务却是相对较新的现象!2.75G 网络的历史 barely 超过二十年,却仍在全球广泛使用。然而,现在我们大多数人简直无法想象没有高速无线接入的生活。采用速度和无线技术的演进之快,令人叹为观止。

3GPP 与 3GPP2 联盟

一旦消费者对无线数据服务的需求开始增长,无线网络互操作性问题就成了所有相关方的热点议题。首先,电信运营商必须购买和部署无线接入网(RAN)的硬件,这需要巨额资本投资和持续维护——标准化硬件意味着更低的成本。同样,如果没有全行业范围的标准,用户将被限制在其归属网络中,限制了移动数据接入的使用场景和便利性。

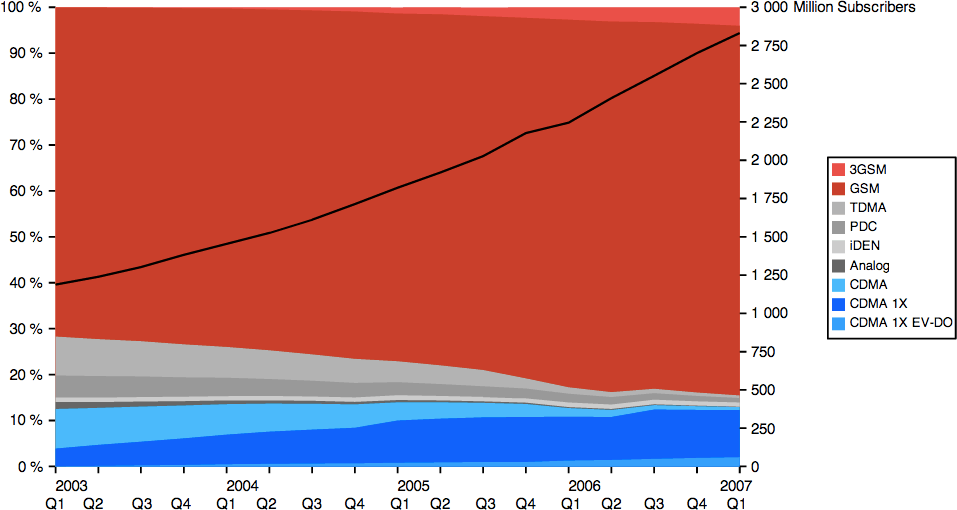

作为回应,欧洲电信标准协会(ETSI)于 1990 年代初开发了 GSM 标准,迅速被许多欧洲国家及全球采用。事实上,GSM 后来成为部署最广泛的无线标准,据估计覆盖了80%–85% 的市场份额(图 7-1)。但它并非唯一。与此同时,高通开发的IS-95标准也占据了10%–15% 的市场份额,尤其在北美有许多网络部署。因此,为 IS-95 无线网络设计的设备无法在 GSM 网络上运行,反之亦然——这一不幸的特性对许多国际旅行者来说再熟悉不过。

图 7-1. 2003–2007 年移动标准市场份额(维基百科)

图 7-1. 2003–2007 年移动标准市场份额(维基百科)

1998 年,认识到已部署标准需要全球演进以及定义下一代(3G)网络需求的必要性,GSM 和 IS-95 标准组织的参与者成立了两个全球合作项目:

第三代合作伙伴计划(3GPP)

- 负责开发通用移动通信系统(UMTS),这是 GSM 网络的 3G 升级。后来,它还承担了 GSM 标准的维护以及新 LTE 和 5G 标准的开发。

第三代合作伙伴计划 2(3GPP2)

- 负责基于CDMA2000技术开发 3G 规范,这是高通开发的 IS-95 标准的后继者。

因此,两种类型的标准(表 7-3)及相关网络基础设施的开发并行推进。或许并非完全同步,但基本遵循了底层技术的相似演进路径。

| 代际 | 组织 | 标准 |

|---|---|---|

| 2G | 3GPP | GSM |

| 3GPP2 | IS-95(cdmaOne) | |

| 2.5G, 2.75G | 3GPP | GPRS, EDGE(EGPRS) |

| 3GPP2 | CDMA2000 | |

| 3G | 3GPP | UMTS |

| 3GPP2 | CDMA 2000 1x EV-DO Release 0 | |

| 3.5G, 3.75G, 3.9G | 3GPP | HSPA, HSPA+, LTE |

| 3GPP2 | EV-DO Revision A, EV-DO Revision B, EV-DO Advanced | |

| 4G | 3GPP | LTE-Advanced, LTE-Advanced Pro |

| 5G | 3GPP | NR(New Radio) |

表 7-3. 3GPP 与 3GPP2 开发的蜂窝网络标准

您应该在列表中看到一些熟悉的标签:EV-DO、HSPA、LTE、5G。许多网络运营商投入了巨额营销资源(并持续投入)来推广这些技术作为他们”最新最快的移动数据网络”。然而,我们进行这段历史回顾的兴趣不在于营销,而在于对移动无线行业演进的宏观观察:

- 全球有两种主导的、已部署的移动网络类型。

- 3GPP 和 3GPP2 管理着每种技术的演进。

- 3GPP 和 3GPP2 标准在设备层面不互操作。

不存在单一的 4G 或 3G 技术。**国际电信联盟(ITU)**为每一代无线技术制定国际标准及性能特征(如数据速率和延迟),然后 3GPP 和 3GPP2 组织在其各自技术背景下定义满足并超越这些预期的标准。

如何知道您的运营商使用的是哪种网络类型?很简单。您的手机有 SIM 卡吗?如果有,那就是从 GSM 演进而来的 3GPP 技术。要获取有关网络的更详细信息,请查看运营商的 FAQ,或者如果您的手机允许,直接在手机上查看网络信息。

对于 Android 用户,打开手机拨号界面并输入:*#*#4636#*#*。如果您的手机允许,这将打开一个诊断屏幕,您可以在其中检查移动连接的状态和类型、电池诊断等信息。

3G 技术的演进

在 3G 网络的背景下,我们有两种主导且相互竞争的标准:UMTS 和基于 CDMA 的网络,分别由 3GPP 和 3GPP2 开发。然而,正如前面的蜂窝标准表(表 7-3)所示,每种标准还细分为几个过渡性里程碑:3.5G、3.75G 和 3.9G 技术。

为什么不能直接跳到 4G?嗯,标准制定需要很长时间,但更重要的是,部署新网络基础设施需要巨额资金成本。正如我们将看到的,4G 需要与 3G 完全不同的无线接口和并行基础设施。因此,也为了已购买 3G 手机的众多用户的利益,3GPP 和 3GPP2 都继续演进现有的 3G 标准,这也使运营商能够对其现有网络进行增量升级,为现有用户提供更好的性能。

毫不奇怪,各种 3G 网络的吞吐量、延迟和其他性能特征随着每次新版本发布而改善,有时甚至 dramatically。事实上,从技术角度看,LTE 曾被认为是 3.9G 过渡标准!然而,在我们讨论 LTE 之前,让我们更仔细地看看各种 3GPP 和 3GPP2 的里程碑。

3GPP 技术演进

| 版本 | 日期 | 摘要 |

|---|---|---|

| 99 | 1999 | UMTS 标准的首个版本 |

| 4 | 2001 | 引入全 IP 核心网 |

| 5 | 2002 | 引入高速分组下行接入(HSDPA) |

| 6 | 2004 | 引入高速分组上行接入(HSUPA) |

| 7 | 2007 | 引入高速分组接入演进(HSPA+) |

| 8 | 2008 | 引入新的 LTE 系统架构演进(SAE) |

| 9 | 2009 | SAE 改进及 WiMAX 互操作性 |

| 10 | 2010 | 引入 4G LTE-Advanced 架构 |

| 15+ | 2018+ | 5G NR(New Radio)标准 |

表 7-4. 3GPP 版本历史

对于遵循 3GPP 标准的网络,HSDPA 和 HSUPA 版本的组合通常被称为**高速分组接入(HSPA)**网络。这两个版本的组合使真实部署中的吞吐量达到低个位数 Mbit/s,相比早期 3G 速度是一个显著提升。HSPA 网络通常被标记为 3.5G。

接下来的升级是HSPA+(3.75G),它通过简化的核心网架构提供了显著更低的延迟,真实部署中的数据速率达到中高个位数 Mbit/s。然而,正如我们将看到的,引入 HSPA+的第 7 版本并非该技术的终点。事实上,HSPA+标准自那时起持续优化,现在正与 LTE 和 LTE-Advanced 正面竞争!

3GPP2 技术演进

| 版本 | 日期 | 摘要 |

|---|---|---|

| Rel. 0 | 1999 | 1x EV-DO 标准的首个版本 |

| Rev. A | 2001 | 峰值数据速率升级、更低延迟和 QoS |

| Rev. B | 2004 | 为 Rev. A 引入多载波能力 |

| Rev. C | 2007 | 提高核心网效率和性能 |

表 7-5. 3GPP2 CDMA2000 1x EV-DO 标准版本历史

3GPP2 开发的 CDMA2000 EV-DO 标准遵循了类似的网络升级路径。首个版本(Rel. 0)实现了低个位数 Mbit/s 的下行吞吐量,但上行速度很低。Rev. A 解决了上行性能问题,Rev. B 进一步改善了上行和下行速度。因此,Rev. B 网络能够向用户提供中高个位数 Mbit/s 的性能,使其可与 HSPA 和早期 HSPA+网络相媲美——即 3.5–3.75G。

Rev. C 版本也常被称为EV-DO Advanced,在容量和性能方面提供了显著的运营改进。然而,EV-DO Advanced 的采用远不如 HSPA+强劲。为什么?如果您仔细关注标准代际表(表 7-3),您可能已经注意到3GPP2 没有官方的竞争性 4G 标准!

虽然 3GPP2 本可以继续演进其 CDMA 技术,但在某个时点,网络运营商和网络设备供应商都同意将3GPP LTE作为所有类型网络的共同 4G 后继者。因此,许多 CDMA 网络运营商也是最早投资早期 LTE 基础设施的运营商之一,部分原因是为了能够与持续的 HSPA+改进竞争。

换句话说,全球大多数移动运营商正 converge 于 HSPA+和 LTE 作为未来的移动无线标准——这是好消息。话虽如此,不要屏住呼吸。现有的 2G 和 3–3.75G 技术仍在为绝大多数已部署的移动无线网络提供动力,更重要的是,它们将继续运营至少另一个十年。

3G 常被描述为”移动宽带”。然而,宽带是一个相对术语。有人将其定义为至少 256 Kbit/s 的通信带宽,其他人则定义为超过 640 Kbit/s,但事实是,这个数值随着我们试图实现的体验而不断变化。随着服务演进并需要更高吞吐量,宽带的定义也随之改变。

从这个角度看,将 3G 标准视为针对并超越Mbit/s 带宽阈值可能更有用。超过 Mbit/s 障碍多少?嗯,这取决于标准的发布版本(如前所述)、运营商的网络配置以及所用设备的能力。

IMT-Advanced 4G 要求

在我们剖析各种 4G 技术之前,理解”4G”标签背后的含义非常重要。就像 3G 一样,不存在单一的 4G 技术。相反,4G 是 ITU 于 2008 年制定并发布的一套要求(IMT-Advanced)。任何满足这些要求的技术都可以被标记为 4G。

IMT-Advanced 的一些示例要求包括:

- 基于 IP 分组交换网络

- 与先前无线标准(3G 和 2G)互操作

- 移动客户端 100 Mbit/s 数据速率,静止时 Gbit/s+

- 控制面延迟低于 100 ms,用户面延迟低于 10 ms

- 用户间网络资源的动态分配和共享

- 使用可变带宽分配,从 5 到 20 MHz

实际列表要长得多,但以上捕捉了对我们的讨论重要的亮点:与早期代际相比更高的吞吐量和显著更低的延迟。有了这些标准,我们现在知道如何对 4G 网络进行分类——对吧?没那么快,那太容易了!营销部门也必须发表意见。

LTE-Advanced是专门为满足所有 IMT-Advanced 标准而开发的标准。事实上,它也是首个做到这一点的 3GPP 标准。然而,如果您仔细观察,您会注意到**LTE(第 8 版)和LTE-Advanced(第 10 版)**实际上是不同的标准。从技术角度看,LTE 确实应该被视为 3.9G 过渡标准,尽管它为满足 4G 要求奠定了必要的基础——它几乎达到了,但还不完全!

然而,这正是营销介入的地方。3G 和 4G 商标由 ITU 持有,因此其使用应与每一代际的定义要求相对应。除了运营商赢得了一场营销 coup,能够将”4G”商标重新定义为包含一组显著接近4G 要求的技术。因此,**LTE(第 8 版)和大多数HSPA+**网络,尽管不满足实际的技术 4G 要求,仍被营销为”4G”。

那么真正的(LTE-Advanced)4G 部署呢?那些正在到来,但鉴于其前辈,这些网络将如何营销仍有待观察。无论如何,关键是,如今许多运营商使用的”4G”标签是模糊的,您应该阅读细则以了解其背后的技术。

长期演进(LTE)

尽管 3G 标准持续演进,但对高数据传输速度和更低延迟的需求增加暴露了早期 UMTS 技术中一些固有的设计限制。为解决这一问题,3GPP 着手重新设计核心网和无线网络,从而创造了 aptly named **长期演进(LTE)**标准:

- 全 IP 核心网

- 简化的网络架构以降低成本

- 用户面(<10 ms)和控制面(<100 ms)的低延迟

- 新的无线接口和调制方式以实现高吞吐量(100 Mbps)

- 能够使用更大的带宽分配和载波聚合

- MIMO 作为所有设备的必备要求

毫不奇怪,上述列表读起来应该与我们之前看到的 IMT-Advanced 要求相似。LTE(第 8 版)为新网络架构奠定了基础,LTE-Advanced(第 10 版)提供了必要的改进以满足 IMT-Advanced 设定的真正 4G 要求。

此时需要注意的是,由于无线和核心网实现的差异,LTE 网络不是现有 3G 基础设施的简单升级。相反,LTE 网络必须在现有 3G 基础设施的并行频谱上单独部署。然而,由于 LTE 是 UMTS 和 CDMA 标准的共同后继者,它确实提供了与两者互操作的方式:LTE 用户可以无缝切换到 3G 网络,并在 LTE 基础设施可用时迁移回来。

最后,顾名思义,LTE 无疑是几乎所有未来移动网络的长期演进计划。唯一的问题是,这个未来有多远?一些运营商已经开始投资 LTE 基础设施,许多其他运营商正在寻找频谱、资金或两者兼有以这样做。然而,当前行业估计显示,这一迁移确实将是长期的——可能在未来十年左右的过程中。与此同时,**HSPA+**正准备占据中心舞台。

每个支持 LTE 的设备必须拥有多个无线电以实现强制的 MIMO 支持。然而,每个设备还需要用于早期 3G 和 2G 网络的单独无线接口。如果您在计数,这意味着每个手机中有三到四个无线电!对于 LTE 的更高数据速率,您需要 4x MIMO,这使总数达到五到六个无线电。您还在疑惑为什么电池耗得这么快吗?

5G 时代的来临

虽然 HSPA+和 LTE-Advanced 在 2010 年代主导了移动网络演进,但行业已经在展望下一代。**5G NR(New Radio)**于 2018 年由 3GPP 在第 15 版中标准化,带来了革命性的变化:

| 特性 | 4G LTE-Advanced | 5G NR |

|---|---|---|

| 峰值数据速率 | 1 Gbit/s | 20 Gbit/s(下行)/ 10 Gbit/s(上行) |

| 用户面延迟 | < 5 ms | < 1 ms |

| 连接密度 | 10^5 设备/km² | 10^6 设备/km² |

| 移动性支持 | 350 km/h | 500 km/h |

| 频谱效率 | 1x | 3x |

| 能效 | 1x | 100x |

表 7-6. 4G 与 5G 关键指标对比

5G 不仅仅是一次渐进式升级,它引入了三个全新的应用场景:

- 增强型移动宽带(eMBB):为高清视频、VR/AR 和沉浸式体验提供极高吞吐量

- 超可靠低延迟通信(URLLC):为自动驾驶、远程手术和工业自动化提供<1 ms 延迟和 99.999%可靠性

- 大规模机器类通信(mMTC):为物联网设备提供超低功耗、海量连接能力

5G 使用毫米波(mmWave) 频段(24–100 GHz)实现超高速率,同时使用中低频段(Sub-6 GHz)提供广覆盖。然而,毫米波的覆盖范围有限,穿透能力差,这推动了小基站密集部署和 波束成形 技术的发展。

截至 2024 年,全球 5G 用户已超过20 亿,预计到 2030 年将占所有移动连接的近一半。与前几代不同,5G 的部署速度更快,这得益于软件定义网络(SDN)和网络功能虚拟化(NFV)技术,使运营商能够更灵活地升级基础设施。

为多代际未来而构建

在我们这个行业,水晶球占卜是一种危险的实践。然而,到这一点我们已经涵盖了足够的内容,可以对当前部署的移动网络做出合理预测,以及未来几年我们可能处于什么位置。

首先,无线标准正在快速演进,但这些网络的物理部署既是成本高昂又是耗时的 exercise。此外,一旦部署,网络必须维护相当长的时间以收回成本并保持现有客户在线。换句话说,虽然围绕 5G 有很多炒作和营销,旧代际网络将继续运营至少另一个十年。在为移动网络构建时,请相应规划。

具有讽刺意味的是,虽然 4G 和 5G 网络为 IP 数据传输提供了显著改进,但 3G 网络在处理老式语音流量方面仍然更有效!**VoLTE(LTE 语音)和VoNR(5G 新空口语音)**目前已广泛部署,旨在实现 4G/5G 上高效可靠的语音传输,但许多早期 4G 部署仍依赖旧的电路交换基础设施进行语音传输。

因此,在为移动网络构建应用程序时,我们不能针对单一类型或代际的网络,更不能期望特定的吞吐量或延迟性能。正如我们所见,任何网络的实际性能都高度可变,基于部署版本、基础设施、无线电条件和数十个其他变量。我们的应用程序应该适应网络中不断变化的条件:吞吐量、延迟,甚至无线电连接的可用性。当用户在移动时,很可能根据可用覆盖范围和信号强度在多个代际网络(5G、LTE、HSPA+、HSPA、EV-DO,甚至 GPRS Edge)之间切换。如果应用程序未能考虑到这一点,用户体验将受到影响。

好消息是 HSPA+、LTE 和 5G 的采用正在快速增长,这 enable 了以前不可能的全新类别的高吞吐量和延迟敏感应用程序。三者在吞吐量和延迟方面实际上不相上下(表 7-7):真实环境中的中高两位数 Mbps 吞吐量,以及低于 100 毫秒(5G 低于 10 毫秒)的延迟,使它们可与许多家庭和办公室 WiFi 网络相媲美。

| HSPA+ | LTE | LTE-Advanced | 5G NR | |

|---|---|---|---|---|

| 峰值下行速度(Mbit/s) | 168 | 300 | 3,000 | 20,000 |

| 峰值上行速度(Mbit/s) | 22 | 75 | 1,500 | 10,000 |

| 最大 MIMO 流数 | 2 | 4 | 8 | 64–256 |

| 空闲到连接延迟(ms) | < 100 | < 100 | < 50 | < 10 |

| 休眠到激活延迟(ms) | < 50 | < 50 | < 10 | < 1 |

| 用户面单向延迟(ms) | < 10 | < 5 | < 5 | < 1 |

表 7-7. HSPA+、LTE、LTE-Advanced 与 5G NR 对比

然而,虽然 4G 和 5G 无线性能常与 WiFi 或有线宽带相比,但假设我们可以将它们视为相同环境则是错误的:它们绝对不是。

例如,大多数用户和开发者期望”始终在线”的体验,设备永久连接到互联网并准备即时响应用户输入或传入数据包。这一假设在有线世界中成立,但对移动网络绝对是错误的。电池寿命和设备能力等实际约束意味着我们必须明确意识到移动网络的约束来设计我们的应用程序。要理解这些差异,让我们深入挖掘。

设备特性与能力

常被遗忘的是,部署的无线电网络只是等式的一半。不用说,不同制造商和发布日期的设备将具有非常不同的特性:CPU 速度和核心数、可用内存量、存储容量、GPU 等。每个因素都会影响设备的整体性能以及在其上运行的应用程序。

然而,即使考虑了所有这些变量,当谈到网络性能时,还有一个部分常被忽视:无线电能力。具体来说,用户手中的设备也必须能够利用部署的无线电基础设施!运营商可能部署了最新的 5G 基础设施,但为早期版本设计的设备可能根本无法利用它,反之亦然。

用户设备等级

3GPP 和 3GPP2 标准持续演进并增强无线接口要求:调制方案、无线电数量等。要从任何网络获得最佳性能,设备还必须满足每种网络类型的指定用户设备(UE)等级要求。事实上,对于每个版本,通常有多个 UE 等级,每个等级提供非常不同的无线电性能。

一个明显而重要的问题是:为什么?再次,答案很简单:成本。多种设备等级的可用性使设备差异化、为价格敏感用户提供各种价格点以及适应地面部署的网络基础设施成为可能。

仅 HSPA 标准就指定了超过 36 种可能的 UE 等级!因此,仅仅说您拥有”HSPA capable 设备”(表 7-8)是不够的——您需要阅读细则。例如,假设无线电网络有能力,要获得 42.2 Mbps/s 的吞吐量,您还需要等级 20(2x MIMO)或等级 24(双小区)设备。最后,为了进一步混淆 matters,等级 21 设备并不能自动保证比等级 20 手机更高的吞吐量。

| 3GPP 版本 | 等级 | MIMO, 多小区 | 峰值数据速率(Mbit/s) |

|---|---|---|---|

| 5 | 8 | — | 7.2 |

| 5 | 10 | — | 14.0 |

| 7 | 14 | — | 21.1 |

| 8 | 20 | 2x MIMO | 42.2 |

| 8 | 21 | 双小区 | 23.4 |

| 8 | 24 | 双小区 | 42.2 |

| 10 | 32 | 四小区 + MIMO | 168.8 |

表 7-8. 3GPP HSPA 用户设备(UE)等级示例

同样,LTE 标准定义了自己的用户设备等级集(表 7-9):高端智能手机可能是等级 3–5 设备,但它也可能与许多更便宜的等级 1–2 邻居共享网络。需要 4x 甚至 8x MIMO 的更高 UE 等级更可能出现在专用设备中——同时为那么多无线电供电消耗大量电力,对于口袋里的东西来说可能不太实用!

| 3GPP 版本 | 等级 | MIMO | 峰值下行(Mbit/s) | 峰值上行(Mbit/s) |

|---|---|---|---|---|

| 8 | 1 | 1x | 10.3 | 5.2 |

| 8 | 2 | 2x | 51.0 | 25.5 |

| 8 | 3 | 2x | 102.0 | 51.0 |

| 8 | 4 | 2x | 150.8 | 51.0 |

| 8 | 5 | 4x | 299.6 | 75.4 |

| 10 | 6 | 2x 或 4x | 301.5 | 51.0 |

| 10 | 7 | 2x 或 4x | 301.5 | 102.0 |

| 10 | 8 | 8x | 2998.6 | 1497.8 |

表 7-9. LTE 用户设备(UE)等级

5G 进一步扩展了这一概念,引入了更复杂的等级系统,支持大规模 MIMO(64–256 天线)、毫米波操作和载波聚合。

在实践中,大多数早期 LTE 部署针对等级 1–3 设备,早期 LTE-Advanced 网络以等级 3 作为主要 UE 类型。5G 设备通常从等级 1(基础宽带)到等级 4(高端智能手机和 CPE)不等。

如果您拥有 5G、LTE 或 HSPA+设备,您知道它的等级分类吗?一旦您弄清楚这一点,您知道您的网络运营商运行的是哪个 3GPP 版本吗?要获得最佳性能,两者必须匹配。否则,您将受到无线电网络或所用设备能力的限制。

解读移动设备上的无线电规格

如果您曾经阅读过移动设备的技术规格,您无疑会在连接部分注意到频率和技术类型的一长串令人困惑的列表。好吧,现在我们应该有足够的知识来解读这个列表了!作为示例,让我们看看Google Pixel 8的规格:

- 5G(Sub-6 GHz 和 mmWave):n1, n2, n3, n5, n7, n8, n12, n20, n25, n28, n38, n40, n41, n66, n71, n77, n78, n257, n258, n260, n261

- LTE(FDD/TDD):Bands 1–5, 7–8, 12–14, 17–20, 25–30, 38–43, 46, 48, 66, 71

- UMTS/HSPA+/HSDPA:Bands 1–2, 4–6, 8–9, 19

- GSM/EDGE:850, 900, 1800, 1900 MHz

第一行告诉我们该设备可以在 5G 网络上运行,支持 Sub-6 GHz 和毫米波频段——峰值数据速率可达10 Gbit/s。列出的频段表示无线电能够在哪些频段上运行,以适应全球不同的法规和网络部署。

第二行显示 LTE 支持,涵盖广泛的 FDD 和 TDD 频段,确保全球兼容性。第三行显示向后兼容 3G 网络。最后,第四行显示 2G 能力,用于语音回落和全球漫游。

这款设备是 5G 等级 4 设备,支持 4x4 MIMO 和载波聚合,在理想条件下可实现数 Gbit/s的实际吞吐量。许多现代手机已经是微型化的奇迹,但当我们意识到大多数现代手机不只有一个无线电,而是有五到七个无线电(2G、3G、4G、5G Sub-6、5G mmWave、WiFi、蓝牙、NFC、GPS)时,这一事实更加令人印象深刻!

无线资源控制器(RRC)

3G、4G 和 5G 网络都有一个在 tethered 甚至 WiFi 网络中不存在的独特特性。无线资源控制器(RRC) 调解使用中的设备与无线电基站之间的所有连接管理(图 7-4)。理解它为何存在以及它如何影响移动网络上每个设备的性能,对于构建高性能移动应用程序至关重要。RRC 直接影响使用设备的延迟、吞吐量和电池寿命。

图 7-4. 无线资源控制器

当使用物理连接(如以太网电缆)时,您的计算机拥有直接且始终在线的网络链路,允许连接的任何一方随时发送数据包;这是最小化延迟的最佳情况。正如我们在”从以太网到无线局域网”中看到的,WiFi 标准遵循类似模型,每个设备能够在任何时间点传输。这在最佳情况下也提供了最小延迟,但由于使用共享无线介质,如果有许多活跃用户,也可能导致高冲突率和不可预测的性能。此外,因为任何 WiFi 对等点都可能随时开始传输,所有其他对等点也必须准备接收。无线电始终开启,消耗大量电力。

在实践中,始终让 WiFi 无线电保持活跃实在太昂贵,因为大多数设备的电池容量有限。因此,WiFi 提供了一种小型功耗优化,其中接入点在周期性信标帧内广播传输流量指示消息(DTIM),指示它将在之后立即为某些客户端传输数据。反过来,客户端可以监听这些 DTIM 帧作为无线电何时应准备接收的提示,否则无线电可以休眠直到下一次 DTIM 传输。这降低了电池使用但增加了额外延迟。

最新的**WiFi 6(802.11ax)和WiFi 7(802.11be)**标准通过目标唤醒时间(TWT)等机制进一步提高了 WiFi 设备的电源效率。

therein lies 3G、4G 和 5G 网络的问题:网络效率和电源。或者更确切地说,由于缺乏电源——移动设备受限于电池容量以及小区中显著更多活跃用户之间的高网络效率要求。这就是 RRC 存在的原因。

顾名思义,无线资源控制器承担调度谁何时通话、分配带宽、使用的信号功率、每个设备的电源状态以及数十个其他变量的全部责任。简而言之,RRC 是无线接入网的大脑。想通过无线信道发送数据?您必须首先请求 RRC 为您分配一些无线电资源。有来自互联网的传入数据?RRC 会通知您何时收听以接收入站数据包。

好消息是所有 RRC 管理都由网络执行。坏消息是,虽然您不一定能通过 API 控制 RRC,但如果您确实想为 3G、4G 和 5G 网络优化您的应用程序,那么您需要了解并在 RRC 施加的约束内工作。

RRC 存在于无线网络中。在 2G 和 3G 网络中,RRC 位于核心运营商网络中,在 4G 和 5G 中,RRC 逻辑已直接移至服务无线电塔(eNodeB/gNodeB)以提高性能并降低协调延迟。

3G、4G 与 WiFi 的功耗需求

无线电是任何手机中最耗电的组件之一。事实上,屏幕是唯一在活跃时消耗更高电量的组件——强调活跃时。在实践中,屏幕在相当长的时间内是关闭的,而无线电必须维持”始终在线”体验的 illusion,以便用户随时可联系。

实现这一目标的一种方法是让无线电始终活跃,但即使有了最新的电池容量进步,这样做也会在几小时内耗尽电池。更糟糕的是,最新迭代的 3G、4G 和 5G 标准需要并行传输(MIMO、多小区等),这相当于同时为多个无线电供电。在实践中,必须在保持无线电活跃以服务低延迟交互流量和循环进入低功耗状态以实现合理的电池性能之间取得平衡。

不同技术如何比较,哪种对电池寿命更好?没有单一答案。使用 WiFi 时,每个设备设置自己的传输功率,通常在30–200 mW范围内。相比之下,3G/4G/5G 无线电的传输功率由网络管理,在空闲状态时可低至15 mW。然而,为了 account for 更大的范围和干扰,同一无线电在高功率状态传输时可能需要1,000–3,500 mW!

在实践中,传输大量数据时,如果信号强度良好,WiFi 通常效率更高。但如果设备 mostly 空闲,那么 3G/4G/5G 无线电更有效。为获得最佳性能,理想情况下我们希望在不同连接类型之间动态切换。然而,至少目前,不存在这样的机制。这是行业和学术界的一个活跃研究领域。

那么电池和电源管理如何影响网络性能?信号功率(在”信号功率”中解释)是实现更高吞吐量的主要杠杆之一。然而,高传输功率消耗大量能量,因此可能受到限制以实现更好的电池寿命。同样,关闭无线电也可能完全 tear down 与无线电塔的无线电链路,这意味着在发生新传输时,必须首先交换一系列控制消息以重新建立无线电上下文,这可能增加数十甚至数百毫秒的延迟。

吞吐量和延迟性能都直接受到使用设备的电源管理配置文件的影响。事实上,这是关键,在 3G、4G 和 5G 网络中,无线电电源管理由 RRC 控制:它不仅告诉您何时通信,还会告诉您传输功率以及何时循环进入不同电源状态。

LTE RRC 状态机

每个 LTE 设备的无线电状态由当前服务用户的无线电塔控制。事实上,3GPP 标准定义了一个 well-specified 状态机,描述连接到网络的每个设备的可能电源状态(图 7-5)。运营商可以修改触发状态转换的参数,但状态机本身在所有 LTE 部署中都是相同的。

图 7-5. LTE RRC 状态机

RRC 空闲

- 设备无线电处于低功耗状态(<15 mW),仅监听控制流量。在运营商网络内没有为客户端分配无线电资源。

RRC 连接

- 设备无线电处于高功耗状态(1000–3500 mW),在传输数据或等待数据时,无线电网络分配了专用无线电资源。

设备要么处于空闲状态,仅监听控制信道广播(如入站流量的寻呼通知),要么处于连接状态,网络为客户端建立了上下文和资源分配。

在空闲状态时,设备无法发送或接收任何数据。为此,它必须首先通过监听网络广播与网络同步,然后向 RRC 发出请求以移至”连接”状态。这一协商可能需要与无线电塔进行几次往返,3GPP LTE 规范为此状态转换分配了100 毫秒或更少的目标时间。在 LTE-Advanced 中,该目标时间进一步降低至50 毫秒。

一旦处于连接状态,无线电塔与 LTE 设备之间就建立了网络上下文,可以传输数据。然而,一旦任一方完成预期的数据传输,RRC 如何知道何时将设备转换到低功耗状态? trick question —— 它不知道!

IP 流量是突发性的,优化的 TCP 连接是长寿命的,UDP 流量 by design 不提供”传输结束”指示器。因此,与我们在”连接状态超时”中介绍的 NAT 连接状态超时解决方案不同,RRC 状态机依赖于一组计时器来触发 RRC 状态转换。

最后,因为连接状态需要如此高的电量,有多个子状态可用(图 7-5)以允许更高效的运行:

连续接收

- 最高功耗状态,建立的网络上下文,分配的网络资源。

短不连续接收(Short DRX)

- 建立的网络上下文,没有分配的网络资源。

长不连续接收(Long DRX)

- 建立的网络上下文,没有分配的网络资源。

在高功耗状态,RRC 为设备创建通过无线接口接收和传输数据的预留,并通知设备这些时隙是什么、必须使用的传输功率、调制方案以及数十个其他变量。然后,如果设备已空闲配置的的一段时间,它将被转换到 Short DRX 功耗状态,其中网络上下文仍然维持,但没有分配特定的无线电资源。在 Short DRX 状态时,设备仅监听来自网络的周期性广播,这使其能够 preserve 电池——与 WiFi 中的 DTIM 间隔不同。

什么是”分配的无线电资源”?

在 LTE 中,就像在大多数其他现代无线标准中一样,有共享的上行和下行无线信道,其访问由 RRC 控制。在连接状态时,RRC 告诉每个设备哪些时隙分配给哪个设备、必须使用的传输功率、调制方式以及数十个其他变量。

如果移动设备没有 RRC 对这些资源的分配,那么它就无法传输或接收任何用户数据。因此,在 DRX 状态时,设备与 RRC 同步,但没有上行或下行资源分配给它:设备是”半醒着”。

如果无线电保持空闲足够长的时间,它随后将被转换到 Long DRX 状态,这与 Short DRX 状态相同,只是设备在醒来收听广播之间休眠更长的时间(图 7-6)。

图 7-6. 不连续接收:Short DRX 和 Long DRX

如果网络或移动设备必须在无线电处于 Short 或 Long DRX(休眠)状态之一时传输数据,会发生什么?设备和 RRC 必须首先交换控制消息以协商何时传输以及何时收听无线电广播。对于 LTE,这一协商时间(“休眠到连接”)被指定为少于 50 毫秒,对于 LTE-Advanced 进一步收紧至少于 10 毫秒。

那么这一切在实践中意味着什么?根据无线电处于哪种电源状态,LTE 设备可能首先需要10 到 100 毫秒(表 7-10)的延迟与 RRC 协商所需资源。之后,应用程序数据可以通过无线链路、运营商网络传输,然后传输到公共互联网。规划这些延迟,特别是在设计延迟敏感的应用程序时,可能是”不可预测的性能”与优化的移动应用程序之间的全部差异。

| LTE | LTE-Advanced | 5G NR | |

|---|---|---|---|

| 空闲到连接延迟 | < 100 ms | < 50 ms | < 10 ms |

| DRX 到连接延迟 | < 50 ms | < 10 ms | < 1 ms |

| 用户面单向延迟 | < 5 ms | < 5 ms | < 1 ms |

表 7-10. LTE、LTE-Advanced 与 5G NR RRC 延迟

HSPA 与 HSPA+(UMTS)RRC 状态机

LTE 和 LTE-Advanced 之前的早期 3GPP 代际网络具有非常相似的 RRC 状态机,也由无线电网络维护。这是好消息。坏消息是早期代际的状态机稍微复杂一些(图 7-7),而且延迟高得多。事实上,LTE 提供更好性能的原因之一正是由于其简化的架构和改进的 RRC 状态转换性能。

图 7-7. UMTS RRC 状态机:HSPA, HSPA+

空闲

- 与 LTE 中的空闲类似。设备无线电处于低功耗状态,仅监听来自网络的控制流量。在运营商网络内没有为客户端分配无线电资源。

Cell DCH

- 类似于连续接收时的连接 LTE 模式。设备处于高功耗状态,为上行和下行数据传输分配了网络资源。

Cell FACH

- 中间功耗状态,比 DCH 消耗显著更少的功率。设备没有专用网络资源,但仍能够通过共享低速信道(速度通常低于 20 Kbps)传输少量用户数据。

空闲和 DCH 状态几乎与 LTE 中的空闲和连接相同。然而,中间的FACH 状态是 UMTS 网络(HSPA, HSPA+)独有的,允许使用公共信道进行小数据传输:慢而稳,消耗的功率约为 DCH 状态的一半。在实践中,这种状态被设计用于处理非交互式流量,如许多后台应用程序进行的周期性轮询和状态检查。

毫不奇怪,从 DCH 到 FACH 的转换由计时器触发。然而,一旦进入 FACH,什么会触发提升回 DCH?每个设备维护一个要发送的数据缓冲区,只要缓冲区不超过网络配置的阈值(通常 anywhere from 100 到 1,000 字节),设备就可以保持在中间状态。最后,如果在 FACH 中某段时间没有数据传输,另一个计时器将设备转换到空闲状态。

与 LTE 提供两个中间状态(Short DRX 和 Long DRX)不同,UMTS 设备只有一个中间状态:FACH。然而,即使 LTE 在理论上提供更高程度的电源控制,无线电本身在 LTE 设备中 tend to 消耗更多功率;更高的吞吐量以增加电池消耗为代价。因此,LTE 设备仍然比其 3G 前辈具有更高的电源配置文件。

除了各个电源状态之外,早期 3G 网络与 LTE 之间 perhaps 最大的区别是状态转换的延迟。LTE 针对空闲到连接状态的 sub-hundred 毫秒,而相同的从空闲到 DCH 的转换在 3G 设备中可能需要长达两秒,并需要与 RRC 进行数十条控制消息的交换!FACH 到 DCH 也好不到哪里去,状态转换需要长达 1.5 秒。

好消息是最新的 HSPA+网络在这方面做出了显著改进,现在与 LTE 具有竞争力(表 7-7)。然而,我们不能指望普遍接入 4G、5G 或 HSPA+网络;旧代际的 3G 网络将继续存在至少另一个十年。因此,所有移动应用程序在通过 3G 接口访问网络时都应该规划多秒级的 RRC 延迟。

EV-DO(CDMA)RRC 状态机

虽然 3GPP 标准如 HSPA、HSPA+和 LTE 是全球主导的网络标准,但我们不能忘记 3GPP2 基于 CDMA 的网络。EV-DO 网络的增长曲线可能看起来相对平缓,但即便如此,当前行业预测显示到 2017 年仍有近5 亿CDMA 驱动的无线用户(注:到 2024 年,这一数字已大幅下降,因为大多数运营商已迁移到 LTE/5G)。

毫不奇怪,无论标准有何差异,UMTS 和 CDMA 网络中的基本限制是相同的:电池电源是约束资源,无线电运行昂贵,网络效率是重要目标。因此,CDMA 网络也有 RRC 状态机(图 7-8),控制每个设备的无线电状态。

图 7-8. CDMA RRC 状态机:EV-DO(Rev. 0—DO Advanced)

空闲

- 与 3GPP 标准中的空闲类似。设备无线电处于低功耗状态,仅监听来自网络的控制流量。在运营商网络内没有为客户端分配无线电资源。

连接

- 类似于连接 LTE 模式和 HSPA 中的 DCH。设备处于高功耗状态,为上行和下行数据传输分配了网络资源。

这绝对是我们检查过的所有 RRC 状态机中最简单的:设备要么处于高功耗状态,分配了网络资源,要么处于空闲。此外,所有网络传输都需要转换到连接状态,其延迟与 HSPA 网络相似:根据部署基础设施的版本,数百到数千毫秒。没有其他中间状态,返回空闲的转换也由运营商配置的超时控制。

周期性传输的低效性

无论代际或底层标准如何,由超时驱动的无线电状态转换的一个重要后果是,很容易构造出既对交互流量产生差用户体验又对电池性能产生差影响的网络访问模式。事实上,您所要做的就是等待足够长的时间让无线电转换到低功耗状态,然后触发网络访问以强制 RRC 转换!

为了说明问题,让我们假设设备处于 HSPA+网络,该网络配置为在无线电不活动 10 秒后从 DCH 移动到 FACH 状态。接下来,我们加载一个安排间歇传输的应用程序,如11 秒间隔的实时分析信标。净结果是什么?设备可能最终花费数百毫秒进行数据传输,否则在高功耗状态下空闲。更糟糕的是,它会在仅几百毫秒后再次醒来之前转换到低功耗状态——延迟和电池性能的最坏情况。

每次无线电传输,无论多小,都会强制转换到高功耗状态。然后,一旦传输完成,无线电将保持在这种高功耗状态,直到不活动计时器过期(图 7-9)。实际数据传输的大小不影响计时器。此外,设备随后还可能必须循环通过几个更多的中间状态,然后才能返回空闲。

图 7-9. HSPA+由于 DCH > FACH > IDLE 转换产生的能量尾部

由计时器驱动的状态转换产生的**“能量尾部”**使周期性传输成为移动网络上非常低效的网络访问模式。首先,您必须支付状态转换的延迟成本,然后传输发生,最后无线电空闲,浪费电力,直到所有计时器触发设备才能返回低功耗状态。

46%的电池消耗用于传输 0.2%的总字节数

AT&T 实验室研究发表了一篇优秀的研究论文(“移动应用程序的资源使用分析”),其中分析了许多流行移动应用程序的网络和电池效率。在这些应用程序中,Pandora作为移动网络上间歇性网络传输低效性的绝佳案例研究。

每当 Pandora 用户播放歌曲时,整个音乐文件由应用程序从网络一次性流式传输,这是正确的行为:尽可能突发传输数据,然后尽可能长时间关闭无线电。然而,在音乐传输之后,应用程序会通过每 60 秒发送间歇性分析 ping 来进行周期性受众测量。净效果?分析信标占总传输字节的 0.2%,占应用程序总功耗的 46%!

信标传输很小,但 RRC 状态转换产生的能量尾部使无线电保持活跃的时间显著更长,不必要地浪费了46%的电池。通过将分析数据合并到更少的请求中,或在无线电已经活跃时发送受众数据,我们可以消除不必要的能量尾部,几乎使应用程序的电源效率翻倍!

端到端运营商架构

既然我们已经熟悉了 RRC 和设备能力, zoom out 并考虑运营商网络的整体端到端架构是有用的。我们在这里的目标不是成为每个组件的名称和功能的专家(有数十个),而是强调对数据如何流经运营商网络以及它为何可能影响我们应用程序性能有直接影响的组件。

运营商网络内各种逻辑和物理组件的具体基础设施和名称取决于部署网络的代际和类型:EV-DO vs. HSPA vs. LTE vs. 5G 等。然而,它们之间也有许多相似之处,在本章中我们将检查 LTE 网络的高层架构。

为什么是 LTE?首先,它是新运营商部署最可能的架构。其次,甚至更重要的是,LTE 的关键特性之一是其简化的架构:更少的组件和更少的依赖性也 enable 了改进的性能。

无线接入网(RAN)

无线接入网(RAN) 是每个运营商网络的第一大逻辑组件(图 7-10),其主要职责是调解对已配置无线信道的访问,并将数据包往返于用户设备。事实上,这是由无线资源控制器控制和调解的组件。在 LTE 中,每个无线电基站(eNodeB)托管 RRC,维护 RRC 状态机并为其小区中的每个活跃用户执行所有资源分配。

图 7-10. LTE 无线接入网:跟踪小区和 eNodeB

每当用户有来自附近小区的更强信号,或者其当前小区过载时,他可能会被切换到邻近塔。然而,虽然这在纸面上听起来简单,切换程序也是每个运营商网络内许多额外复杂性的原因。如果所有用户始终保持在固定位置,并保持在单个塔的范围内,那么静态路由拓扑就足够了。然而,正如我们都知道的,情况并非如此:用户是移动的,必须从塔迁移到塔,迁移过程不应中断任何语音或数据流量。不用说,这是一个 nontrivial 的问题。

首先,如果用户的设备可以与任何无线电塔关联,我们如何知道将入站数据包路由到哪里?当然,没有 magic:无线接入网必须与核心网通信以跟踪每个用户的位置。此外,为了处理透明切换,它还必须能够动态更新其现有隧道和路由,而不中断任何现有的、用户发起的语音和数据会话。

在 LTE 中,塔到塔的切换可以在数百毫秒内执行,这将在物理层产生数据交付的轻微暂停,但除此之外,这一程序对用户和她设备上运行的所有应用程序完全透明。在早期代际网络中,这一相同过程可能需要长达数秒。

然而,我们还没完。无线电切换可能是频繁发生的事件,特别是在高密度城市和办公环境中,要求用户的设备即使在空闲时也持续执行小区切换协商将消耗设备上的大量能量。因此,添加了额外的间接层:一个或多个无线电塔被称为形成**“跟踪区域”**,这是由运营商网络定义的逻辑塔分组。

核心网必须知道用户的位置,但通常它只知道跟踪区域,而不知道当前服务用户的具体塔——正如我们将看到的,这对入站数据包的延迟有重要影响。反过来,设备被允许在同一跟踪区域内的塔之间迁移,没有开销:如果设备处于空闲 RRC 状态,设备或无线电网络不会发出通知,这节省了移动手机上的能量。

核心网(CN)

核心网(图 7-11),在 LTE 中也被称为演进分组核心(EPC),负责数据路由、计费和策略管理。简而言之,它是将无线电网络连接到公共互联网的部件。

图 7-11. LTE 核心网(EPC):PGW、PCRF、SGW 和 MME

首先,我们有分组网关(PGW),它是连接移动运营商与公共互联网的公共网关。PGW 是所有外部连接的终止点,无论协议如何。当移动设备连接到运营商网络时,设备的 IP 地址由 PGW 分配和维护。

运营商网络内的每个设备都有一个内部标识符,独立于分配的 IP 地址。反过来,一旦数据包被 PGW 接收,它就被封装并通过 EPC tunnel 到无线接入网。LTE 使用流控制传输协议(SCTP)传输控制面流量,以及GPRS 隧道协议(GTP)和UDP的组合传输所有其他数据。

物理层与应用层连接

设备 IP 地址由 PGW 分配和维护这一事实有许多重要影响。首先,这意味着无线设备可以轻松与多个 IP 地址关联。相反,如果 IP 地址是 premium,那么多个设备可以共享相同的 IP 地址,但为出站和入站流量分配不同的端口:PGW 充当 NAT。事实上,后一种情况相当常见。同一运营商 IP 地址可以分配给其网络内的数十甚至数百个设备。

因此,来自同一设备的流量可能源自多个公共运营商 IP 地址。不要惊讶地看到同一客户端从不同 IP 请求资源!使用 IPv6,这种行为可能会改变,每个设备最终可能获得唯一的 IP 地址。话虽如此,今天很少有运营商支持 IPv6,IPv6 的推出和采用仍然非常缓慢。

然而,除了 IP 分配之外, arguably 更重要的是认识到,因为是 PGW 终止所有连接,设备无线电状态与应用层连接不 tied:在无线网络内拆除无线电上下文会终止设备与无线电塔之间的物理无线电链路,但这不会影响任何 TCP 或 UDP 会话的状态。设备无线电可以处于空闲状态,与本地无线电塔没有链路,而建立的连接由 PGW 维护。

一旦必须交付应用程序数据,就重新建立物理无线电链路,通信恢复,除了重新建立无线电上下文所需的 RRC 协商延迟外,没有其他副作用。

PGW 还执行所有常见的策略执行,如数据包过滤和检查、QoS 分配、DoS 保护等。**策略和计费规则功能(PCRF)**组件负责为分组网关维护和评估这些规则。PCRF 是一个逻辑组件,意味着它可以成为 PGW 的一部分,也可以独立存在。

现在,假设 PGW 从其网络上的一个移动设备接收到来自公共互联网的数据包;它将数据路由到哪里?PGW 不知道用户的实际位置,也不知道无线接入网内的不同跟踪区域。下一步是**服务网关(SGW)和移动性管理实体(MME)**的责任。

PGW 将其所有数据包路由到 SGW。然而,让 matters 更复杂的是,SGW 也可能不知道用户的确切位置。这一功能实际上是 MME 的核心职责之一。移动性管理实体组件实际上是一个用户数据库,管理网络上每个用户的所有状态:他们在网络上的位置、账户类型、计费状态、启用的服务以及所有其他用户元数据。每当用户在网内的位置发生变化时,位置更新就会发送到 MME;当用户打开手机时,认证由 MME 执行,等等。

因此,当数据包到达 SGW 时,会向 MME 发送查询以获取用户的位置。然后,一旦 MME 返回答案,其中包含跟踪区域和服务目标设备的特定塔的 ID,SGW 就可以建立到塔的连接(如果不存在)并将用户数据路由到无线接入网。

简而言之,这就是全部。这一高层架构在所有不同代际的移动数据网络中实际上是相同的。逻辑组件的名称可能不同,但 fundamentally 所有移动网络都受以下工作流程约束:

- 数据到达外部分组网关,将核心网连接到公共互联网。

- 在分组网关应用一组路由和数据包策略。

- 数据从公共网关路由到一个或多个服务网关,作为无线网内设备的移动锚点。

- 用户数据库服务执行网络上每个用户的认证、计费、服务配置和位置跟踪。

- 一旦确定了用户在无线网内的位置,数据就从服务网关路由到适当的无线电塔。

- 无线电塔执行与目标设备的必要资源分配和协商,然后通过无线接口交付数据。

LTE 核心网的简化统一架构

LTE 的主要特性之一是其新的**演进分组核心(EPC)**网络,基于仅 IP 架构设计,通过同一统一网络承载语音和数据。这种设计使运营商能够更 cost-effective 地运营,但也对网络提出了更强的性能要求:语音需要低延迟,4G 速度需要高得多的吞吐量。

EPC 如何实现这些目标?有大量架构改进,但与早期代际网络的主要区别之一是 LTE 核心网的简化架构:一些组件被移除,其他组件被 collapse 到更少的逻辑组件中,许多决策已移至网络的边缘。

例如,在 LTE 中,RRC 由无线电塔(eNodeB)维护,而在早期代际中,RRC 在网络更高层(在服务网关)管理,这对网络内所有控制流量施加了额外的延迟和性能瓶颈。

回传容量与延迟

任何运营商网络性能的一个重要因素是所有逻辑和物理组件之间的配置连接和容量。LTE 无线接口可能能够达到用户与无线电塔之间的100 Mbps,但一旦信号被无线电塔接收,必须有足够的容量将所有这些数据通过运营商网络传输到其实际目的地。此外,不要忘记单个塔应该能够同时服务许多活跃用户!

提供真正的 4G 体验不仅仅是部署新的无线电网络那么简单。核心网也必须升级,EPC 与无线电网络之间必须有足够的容量链路,所有 EPC 组件必须能够处理比任何早期代际网络高得多的数据速率和低得多的延迟。

在实践中,单个无线电塔可能服务多达三个附近的无线电小区,这 easily 累加到数百个活跃用户。每个用户 10+ Mbps 的数据速率要求,每个塔需要专用光纤链路!

不用说,所有这些要求使 4G 网络对运营商来说是一个昂贵的命题:为所有无线站铺设光纤、高性能路由器等。在实践中,现在发现网络的整体性能受到限制的不是无线接口,而是运营商网络的可用回传容量,这并不罕见。

这些性能瓶颈不是作为移动应用程序开发者我们能控制的,但它们确实再次说明了一个重要事实:我们 IP 网络的架构基于尽力而为交付模型,不保证端到端性能。一旦我们从第一跳(即无线接口)移除瓶颈,我们就将瓶颈移到网络中的下一个最慢链路,无论是在运营商网络内还是在通往目的地的路径上的某处。事实上,这并不新鲜;回想我们之前关于有线网络中”最后一英里延迟”的讨论。

仅仅因为您通过 4G 或 5G 接口连接,并不意味着您就保证获得无线接口提供的最大吞吐量。相反,我们的应用程序必须适应无线信道、运营商网络内以及公共互联网上不断变化的网络 weather。

移动网络中的数据包流向

设计移动网络应用程序的主要抱怨之一是延迟的高度可变性。好吧,既然我们已经涵盖了 RRC 和移动网络的高层架构,我们终于可以 connect the dots 并看到数据包的端到端流动,这也应该解释为什么这种可变性存在。更好的是,正如我们将看到的,大部分可变性实际上是非常可预测的!

发起请求

首先,假设用户已经通过 4G 网络认证,移动设备处于空闲状态。接下来,用户输入 URL 并点击”Go”。接下来会发生什么?

首先,因为手机处于空闲 RRC 状态,无线电必须与附近的无线电塔同步并发送请求以建立新的无线电上下文(图 7-12,步骤 1)——这一协商需要手机与无线电塔之间的几次往返,可能需要长达 100 毫秒。对于早期代际网络,RRC 由服务网关管理,这一协商延迟高得多——长达数秒。

一旦建立了无线电上下文,设备就从无线电塔获得了资源分配,并能够以指定的速率和信号功率传输数据(步骤 2)。从用户无线电传输数据包到塔的时间被称为**“用户面单向延迟”,对于 4G 网络需要长达 5 毫秒**。因此,第一个数据包由于需要执行 RRC 转换而产生高得多的延迟,但之后的数据包只要无线电保持在高功耗状态,就只产生恒定的第一跳延迟成本。

图 7-12. LTE 请求流延迟

然而,我们还没完,因为我们只将数据包从设备传输到了无线电塔!从这里,数据包必须通过核心网——通过 SGW 到 PGW(步骤 3)——然后传输到公共互联网(步骤 4)。不幸的是,4G 标准不对这一路径的延迟做出保证,因此这一延迟将因运营商而异。

在实践中,许多已部署的 4G 网络的端到端延迟往往在30–100 毫秒范围内,一旦设备处于连接状态——也就是说,不包括初始数据包产生的控制面延迟。因此,如果总时间中高达 5 毫秒 accounted for 在第一无线跳上,那么其余(25–95 毫秒)就是运营商核心网内的路由和传输开销。

接下来,假设浏览器已获取请求的页面,用户正在与内容互动。无线电已经空闲了几十秒,这意味着 RRC 可能已将用户移至 DRX 状态(LTE RRC 状态机)以节省电池电量并释放网络资源给其他用户。此时,用户决定在浏览器中导航到不同目的地,因此触发新请求。现在会发生什么?

几乎重复我们刚刚看到的相同工作流程,除了因为设备处于休眠(DRX)状态,设备和无线电塔之间可以进行稍微更快的协商(图 7-12,步骤 1)——休眠到连接长达 50 毫秒(表 7-10)。

总之,用户发起新请求会产生几种不同的延迟:

控制面延迟

- RRC 协商和状态转换产生的固定、一次性延迟成本:空闲到活跃**<100 毫秒**,休眠到活跃**<50 毫秒**。

用户面延迟

- 设备和无线电塔之间传输的每个应用程序数据包的固定成本:<5 毫秒。

核心网延迟

- 将数据包从无线电塔传输到分组网关的运营商依赖成本:实践中,30–100 毫秒。

互联网路由延迟

- 运营商分组网关与公共互联网上目的地址之间的可变延迟成本。

前两个延迟受 4G 要求的限制,核心网延迟是运营商特定的,最后一部分是您可以影响的,通过将服务器战略性地定位得离用户更近;参见之前关于光速和传播延迟的讨论。

移动网络中的延迟和抖动

关于移动网络的一个 frequently shared 抱怨是数据包延迟的可变性,或抖动。当然,有许多 contributing 组件可以影响延迟。然而,一旦您将第一个数据包产生的 RRC 状态转换的控制面成本考虑在内,您可能会发现性能实际上比您预期的要可预测得多。

在 LTE 中,控制面开销高达 100 毫秒。使用 LTE-Advanced,这一数字进一步降低至50 毫秒。然而,在早期代际网络中,这一相同协商可能需要数秒!

核心网路由延迟是移动网络中整体数据包延迟的第二个、通常非常大的 contributing 因素。核心网内产生的具体延迟因网络的代际以及运营商部署的具体基础设施而异。然而,虽然很少有运营商公开宣传他们的延迟性能——也许是因为这没什么可骄傲的——但通常可以在他们的技术 FAQ 中找到。

例如,AT&T,美国最大的移动运营商,为其网络内各代际的核心网延迟设定了以下预期,这对整个行业来说很典型:

| LTE | HSPA+ | HSPA | EDGE | GPRS | |

|---|---|---|---|---|---|

| 延迟 | 40–50 ms | 100–200 ms | 150–400 ms | 600–750 ms | 600–750 ms |

表 7-11. AT&T 已部署的 2G–4G 网络的延迟

相比之下,地球赤道周长为 24,901 英里,光传播需要 133.7 毫秒。换句话说,将大多数移动请求视为平均需要至少一次环球旅行,这可能并不完全不合理!

入站数据流

现在让我们检查相反的场景:用户的设备处于空闲状态,但数据包必须从 PGW 路由到用户(图 7-13)。再次 recall,所有连接都在 PGW 终止,这意味着设备可以处于空闲状态,无线电关闭,但设备可能较早建立的连接(如长寿命 TCP 会话)在 PGW 仍然可以处于活跃状态。

图 7-13. LTE 入站数据流延迟

正如我们之前看到的,PGW 将入站数据包路由到 SGW(步骤 1),SGW 转而查询 MME。然而,MME 可能不知道当前服务用户的确切塔; recall,一组无线电塔形成”跟踪区域”。每当用户进入不同的跟踪区域时,其位置会在 MME 中更新,但同一跟踪区域内的塔切换不会触发对 MME 的更新。

相反,如果设备处于空闲状态,MME 会向跟踪区域内的所有塔发送寻呼消息(步骤 2),这些塔转而都在共享无线信道上广播通知(步骤 3),指示设备应重新建立其无线电上下文以接收入站数据。设备定期醒来收听寻呼消息,如果发现自己 on the paging list,则启动与无线电塔的协商(步骤 4)以重新建立无线电上下文。

一旦建立了无线电上下文,执行协商的塔会向 MME 发送回消息(步骤 5)指示用户在哪里,MME 将答案返回给服务网关,网关 finally 将消息路由(步骤 6)到塔,然后塔将消息交付(步骤 7)给设备!呼。

一旦设备处于连接状态,就在无线电塔和服务网关之间建立了直接隧道,这意味着进一步的入站数据包被直接路由到塔,无需寻呼开销,跳过步骤 2–5。再次,第一个数据包在移动网络上产生高得多的延迟成本!为此做好规划。

前面的数据包工作流程对 IP 及其上方的所有层(包括我们的应用程序)是透明的:数据包由 PGW、SGW 和 eNodeB 在每个阶段缓冲,直到它们可以被路由到设备。在实践中,这转化为数据包到达时间的可观察延迟抖动,第一个数据包由于控制面协商而产生最高延迟。

异构网络(HetNets)

现有的 4G 和 5G 无线电和调制技术已经接近期无线信道的理论极限。因此,无线性能的下一个数量级提升不会来自无线接口的改进,而是来自更智能的无线网络拓扑——具体来说,通过**多层异构网络(HetNets)**的广泛部署,这也将需要小区间协调、切换和干扰管理的许多改进。

HetNets 背后的核心思想很简单:不仅仅依赖于覆盖大片地理区域的宏覆盖(为所有用户创建大量竞争),我们还可以用许多小小区覆盖该区域(图 7-14),每个小小区可以最小化路径损耗、需要更低的传输功率,并为所有用户 enable 更好的性能。

图 7-14. 异构网络信息图(爱立信)

单个宏小区可以在低密度无线环境中覆盖数十平方英里,但在实践中,在高密度城市和办公环境中,可能仅限于仅 50 到 300 米!换句话说,它可以覆盖一个小街区或几栋建筑。相比之下,微小区设计用于覆盖特定建筑;皮小区可以服务一个或多个独立楼层,飞小区可以覆盖小公寓并利用您现有的宽带服务作为无线回传。

然而,请注意,HetNets 不仅仅是用许多小小区替换宏小区。相反,HetNets 是在彼此之上分层多个小区!通过部署重叠的无线网络层,HetNets 可以为所有用户提供更好的网络容量和改善的覆盖。然而, outstanding 的挑战在于最小化干扰、提供足够的上行容量,以及创建和改进各种网络层之间无缝切换的协议。

这对构建移动应用程序的开发者意味着什么?预期不同小区之间的切换次数将显著增加,并相应调整:延迟和吞吐量性能可能 vary significantly。

建模和管理无线网络容量

皮小区通常被移动运营商用于将覆盖范围扩展到信号质量可能较差的室内和室外区域,或在电话使用非常密集的区域增加网络容量——例如大型公共区域、会议厅、体育场、火车站等。一些皮小区可能是永久部署的,而其他可能是为特定场合临时搭建的:无线容量规划和建模(图 7-15)既是艺术也是科学!

图 7-15. 使用 TamoGraph 进行无线容量规划

专用建模软件,如前面所示的TamoGraph Site Survey,通常用于建模物理环境、活跃用户数量以及使用的无线技术(前面示例中的 WiFi),以帮助确定所需网络的数量、 placement 和配置。

真实世界的 3G、4G、5G 与 WiFi 性能

到这一点,人们不禁要问,3G、4G 或 5G 网络中的所有额外协议、网关和协商机制是否值得额外的复杂性。相比之下,WiFi 实现要简单得多,而且似乎运行得足够好,不是吗?回答这个问题需要很多 caveats,因为正如我们所见,测量无线性能受制于数十个环境和技术考虑。此外,答案还取决于选择的评估标准:

- 电池性能与网络性能的重要性。

- 每个用户和全网吞吐量性能。

- 延迟和数据包抖动性能。

- 部署的成本和可行性。

- 满足政府和政策要求的能力。

- 以及数十个其他类似标准……

然而,虽然有数十个不同的利益相关者(用户、运营商和手机制造商,仅举几例),每个都有自己的优先列表,但新 4G 和 5G 网络的早期测试显示出非常有希望的结果。事实上,网络延迟、吞吐量和网络容量等关键指标通常优于 WiFi!

作为一个具体例子,密歇根大学与 AT&T 实验室之间的一个联合研究项目在美国范围内进行了测试(图 7-16),比较了 4G、3G 和 WiFi(802.11g, 2.4GHz)性能:

- 性能测量针对 46 个不同的 Measurement Lab 节点进行,这是一个互联网测量工具的开放平台,通过 MobiPerf 开源测量客户端进行。

- 测量在 2011 年末的两个月期间由 3,300 名用户完成。

图 7-16. WiFi、LTE 和 3G 性能的测试结果分析

每个连接类型的箱线图将大量有用信息打包到一个小图形中:须线显示整个分布的范围,箱体显示分布的 25%–75%分位数,箱体中的黑色水平线是中位数。

当然,单一测试并不能证明普遍规则,尤其是在性能方面,但结果 nonetheless 非常有希望:早期 LTE 网络显示出出色的网络吞吐量性能,更令人印象深刻的是,与其他无线标准相比,RTT 和数据包抖动延迟稳定得多。

换句话说,至少就这项测试而言,LTE 提供了与 WiFi 相当甚至更好的性能,这也表明改进的性能是可能的,所有额外的复杂性都得到了回报!移动网络不必慢。事实上,我们有充分的理由相信我们能够而且将会使其更快。

关于 4G 性能研究的完整细节、分析和结论,请参阅 2012 年 MobiSys 上介绍的”4G LTE 网络的性能和功耗特性的深入检查”。